Derin öğrenme, karmaşık problemleri analiz etme ve çözme yeteneği nedeniyle son yıllarda büyük ilgi gören bir yapay zeka alt alanıdır. Büyük miktarda veriden öğrenmek ve zaman içinde performansını artırmak için insan beyninin yapısından sonra modellenen yapay sinir ağlarının (artificial neural networks (ANNs)) kullanılmasını içerir. Derin öğrenme, makinelerin bir zamanlar insanlara özel olduğu düşünülen görevleri yerine getirmesini sağlayarak sağlık, finans, ulaşım ve eğlence dahil olmak üzere çeşitli sektörlerde devrim yaratmıştır.

Bu makalede, derin öğrenmenin temel kavramlarına derinlemesine bir dalış yapacağız. Yapay sinir ağlarını (YSA) ve bunların nöronlar ve aktivasyon fonksiyonları gibi temel bileşenlerini açıklayarak başlayacağız. Ardından, geri yayılım olarak bilinen YSA'ları eğitmek için önemli algoritmayı tartışacağız ve örüntü tanıma için kullanılan YSA'lar olan çok katmanlı algılayıcıları keşfedeceğiz. Ayrıca, görüntü ve video tanıma için yaygın olarak kullanılan evrişimli sinir ağlarını ve sıralı verileri işleyebilen tekrarlayan sinir ağlarını da ele alacağız. Son olarak, bilgileri daha uzun süre saklayan bir tür tekrarlayan sinir ağı olan uzun kısa süreli bellek ağlarını ve verilerin verimli temsillerini öğrenen oto kodlayıcıları keşfedeceğiz.

Bu blog yazımızı okumayı bitirdiğinizde, derin öğrenmenin temel kavramlarını ve bunların gerçek dünyadaki sorunları çözmek için nasıl kullanıldığını net bir şekilde anlayacaksınız. Öyleyse, derin öğrenme dünyasına dalalım ve büyüleyici kavramlarını keşfedelim.

Derin Öğrenme Nedir?

Derin Öğrenme, Makine Öğreniminin son yıllarda giderek daha popüler hale gelen bir alt alanıdır. Temel amacı, büyük miktarda veriden öğrenebilen akıllı makineler yaratmaktır. Genellikle sinir ağları ile ilişkilendirilse de Derin Öğrenme, temsil öğrenimi gibi daha gelişmiş teknikleri kapsar. Derin Öğrenmede veriler, her katmanın daha basit katmanlar üzerine inşa edildiği ve otomatik özellik çıkarımına izin veren katmanlı bir kavram hiyerarşisi olarak temsil edilir.

Özellik çıkarma ve mühendislik konusunda uzman bilgisi gerektiren geleneksel Makine Öğrenimi teknikleriyle karşılaştırıldığında, Derin Öğrenme algoritmaları daha etkili ve ölçeklenebilirdir, bu da onları büyük miktarda veriyi işlemek için son derece uygun hale getirir Derin Öğrenme algoritmaları, verilerin kendi içinde bulunan temsilleri anlarsa daha iyi performans gösterebilir ve daha az kullanıcı müdahalesi gerektirebilir. Derin Öğrenme, muazzam hacimlerdeki verilerden öğrenebilen akıllı makineler oluşturmak için etkili ve ölçeklenebilir bir yöntemdir.

- Derin Öğrenme algoritmaları zaman içinde daha fazla veriyle daha iyi performans göstermeye başlar ve dağıtılmış temsili öğrenmeye dayanır.

- Sinir ağları derin öğrenme olarak yeniden adlandırılabilir, ancak derin öğrenme geleneksel sinir ağlarından çok daha ileri gider.

- Tensorflow, theano, caffe, mxnet ve keras gibi gelişmiş yazılım çerçeveleri ve daha büyük donanımlar sayesinde artık son derece karmaşık, çok katmanlı Derin Öğrenme modelleri oluşturulabilmektedir.

- Veri bilimciler ve mühendisler, giderek daha karmaşık sorunları ele almak amacıyla yıllardır denetimli öğrenme işlemlerini yürütmek ve özellik çıkarımını otomatikleştirmek için derin öğrenmeyi kullanmaktadır.

Önemli Derin Öğrenme Konseptleri

Şimdi bazı temel Derin Öğrenme mimarisi ve algoritmik terimlerden bahsedelim.

Yapay Sinir Ağları

Yapay Sinir Ağları (YSA), insan beyninin yapısı ve işlevinden sonra modellenen bir tür makine öğrenimi algoritmasıdır. Nöronlar olarak bilinen, bilgi işleyen ve gönderen ağa bağlı düğümlerden oluşurlar. Örüntü tanıma, sınıflandırma ve tahmin, YSA'ların kullanıldığı faaliyetlerden sadece birkaçıdır.

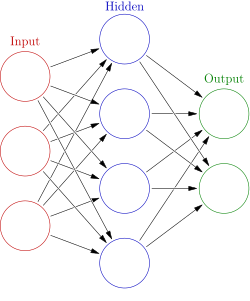

Bir YSA'nın nöronları katmanlar halinde düzenlenir ve her katman bir öncekinden gelen verileri işler. İncelenecek veriler girdi katmanı olarak bilinen ilk katmana iletilirken, çıktı katmanı olarak bilinen son katman sonucu üretir. Arada verileri işleyen ve eldeki iş için önemli özellikleri çıkaran bir veya daha fazla gizli katman bulunabilir.

Eğitim sırasında YSA, girdi verilerinden öğrenmek ve istenen çıktıyı üretmek için nöronlar arasındaki bağlantıların gücünü ayarlar. Bu süreç genellikle, tahmin edilen ve gerçek çıktılar arasındaki hatalara dayalı olarak ağdaki bağlantıların ağırlıklarını yinelemeli olarak ayarlayan geri yayılım adı verilen bir algoritma kullanılarak gerçekleştirilir.

Bir tür makine öğrenimi algoritması olan YSA'lar, birbirine bağlı nöronları kullanarak verileri işler ve yorumlar. Katmanlı bir yapıya sahiptirler ve her katman bir öncekinden gelen verileri işler. YSA'lar girdi verilerinden öğrenmek için geriye yayılma tekniğini kullanır ve istenen çıktıyı üretmek için bağlantılarını değiştirir.

Tipik bir yapay sinir ağı

Tipik bir yapay sinir ağıGeriye Yayılım

Geriye yayılım (Backpropagation), sinir ağı eğitim sürecindeki bir adımdır. Sinir ağı katmanlarındaki ağırlıkları ayarlamak için, bir ileri yayılımın hata oranı katmanlar boyunca geriye doğru beslenir. Sinir ağı eğitiminin temeli geri yayılımdır.

Yapay sinir ağlarını (YSA) eğitmek için kullanılan algoritmanın iki ana aşaması vardır: yayılma ve ağırlık güncellemeleri. Yayılma sırasında, girdi verileri ağ üzerinden iletilerek çıktı değerleri oluşturulur ve bunlar daha sonra istenen çıktı ile karşılaştırılır. Ortaya çıkan hatalar geri yayılım için kullanılır ve her nöronda delta oluşturur. Ağırlık güncellemeleri sırasında, ağırlık gradyanları hesaplanır ve düğümlerin ağırlıklarını güncellemek için kullanılır. Bu süreç, genellikle stokastik gradyan inişi gibi optimizasyon algoritmaları kullanılarak tatmin edici sonuçlar elde edilene kadar çoklu iterasyonlarla tekrarlanır.

Çok Katmanlı Algılayıcılar

Çok Katmanlı Algılayıcılar (Multilayer Perceptrons - MLP), sınıflandırma ve regresyon gibi denetimli öğrenme görevleri için yaygın olarak kullanılan bir yapay sinir ağı (YSA) türüdür. MLP'ler, her katmanın bir önceki katmandan gelen bilgileri işlediği, birbirine bağlı nöronların çoklu katmanlarından oluşur. İlk katman, giriş verilerini alan giriş katmanıdır ve son katman, ağın nihai çıktısını üreten çıkış katmanıdır. Aradaki katmanlar gizli katmanlar olarak adlandırılır ve ağın girdi ve çıktı arasındaki karmaşık ilişkileri modellemesine olanak tanıyan doğrusal olmayan aktivasyon fonksiyonları içerirler.

Eğitim sırasında bir MLP, girdi verilerinden öğrenmek ve istenen çıktıyı üretmek için nöronlar arasındaki bağlantıların gücünü ayarlar. Bu süreç tipik olarak, tahmin edilen ve gerçek çıktılar arasındaki hatalara dayalı olarak ağdaki bağlantıların ağırlıklarını yinelemeli olarak ayarlayan geri yayılım adı verilen bir algoritma kullanılarak gerçekleştirilir. MLP'ler ayrıca aşırı uyumu önlemek ve yeni veriler üzerindeki genelleme performanslarını artırmak için düzenleme tekniklerini de kullanabilir.

Evrişimli Sinir Ağları

Convnet veya CNN olarak da bilinen konvolüsyonel sinir ağı (convolutional neural network), görsel korteksimizin işlevselliğini ve davranışını taklit etme konusunda uzmanlaşmış bir yapay sinir ağı çeşididir. Aşağıdaki üç unsur CNN'lerde sıklıkla bulunur:

- Çoklu konvolüsyonel katmanlar

- Havuzlama katmanları

- Tam bağlantılı MLP'ler

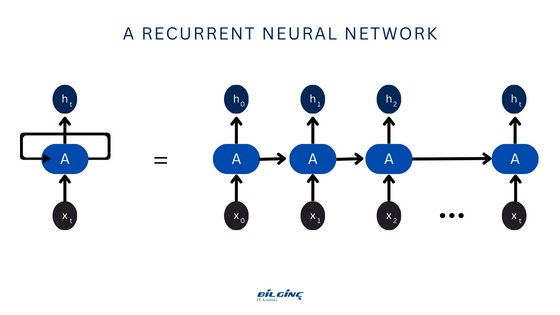

Tekrarlayan Sinir Ağları

Tekrarlayan sinir ağı (Recurrent Neural Network - RNN), düğümler arasındaki bağlantıların bir döngü oluşturabildiği ve bazı düğümlerin çıktısının aynı ağdaki diğer düğümler tarafından alınan girdiyi etkilemesine izin veren bir yapay sinir ağı türüdür. Bu nedenle zamansal olarak dinamik bir şekilde davranabilir. İleri beslemeli sinir ağlarından türeyen RNN'ler, iç durumlarını (belleklerini) kullanarak değişen uzunluktaki girdi dizilerini işleyebilir. Bu nedenle konuşma tanıma veya bölümlere ayrılmamış, bağlantılı el yazısı tanıma gibi görevler için kullanılabilirler. Tekrarlayan sinir ağları, teorik olarak Turing complete oldukları ve herhangi bir programı çalıştırabildikleri için keyfi giriş dizilerini işleyebilirler.

Uzun Kısa Süreli Bellek Ağları

Karmaşık, sıralı verileri modellemek için uzun kısa süreli bellek ağı adı verilen bir tür tekrarlayan sinir ağı yapılır. Geçitli tekrarlayan birimler (GRU'lar) olarak bilinen bir tekniği kullanan LSTM'ler, kaybolan gradyan problemi tarafından kısıtlanan geleneksel RNN'lerin aksine uzun vadeli bağımlılıkları öğrenebilmektedir.

İlk olarak 1997 yılında Hochreiter & Schmidhuber tarafından geliştirilen LSTM'ler, son derece uzun veri dizilerinden elde edilen bilgileri koruyabilir ve geriye yayılımla eğitilen YSA'ları sıklıkla etkileyen kaybolan gradyan sorunu gibi sorunlardan kaçınabilir.

Otomatik Kodlayıcılar

Otomatik kodlayıcılar (Autoencoders), amacın giriş verilerinin sıkıştırılmış bir temsilini öğrenmek olduğu denetimsiz öğrenme için kullanılan bir sinir ağı türüdür. Bir otomatik kodlayıcının temel yapısı, giriş verilerini daha düşük boyutlu bir uzaya eşleyen bir kodlayıcı ve düşük boyutlu temsili orijinal veri alanına geri eşleyen bir kod çözücüden oluşur. Eğitim sırasında otomatik kodlayıcı, giriş verileri ile kod çözücü tarafından üretilen yeniden yapılandırılmış veriler arasındaki farkı en aza indirmeyi öğrenir. Veri sıkıştırma, anormallik tespiti ve özellik çıkarma oto kodlayıcılar için yaygın kullanım alanlarıdır.

Derin Öğrenme Nerelerde Kullanılır?

Derin öğrenme, aşağıdakiler de dahil olmak üzere çok çeşitli uygulamalarda kullanılmaktadır:

- Bilgisayarla Görme: Görüntü ve video tanıma, nesne algılama ve yüz tanıma.

- Doğal Dil İşleme (NLP): Duygu analizi, makine çevirisi, konuşma tanıma ve metin özetleme.

- Robotik: Nesne tanıma, hareket planlama ve kontrol.

- Sağlık Hizmetleri: Hastalık teşhisi, ilaç keşfi ve kişiselleştirilmiş tıp.

- Otonom Sürüş: Nesne algılama, şerit algılama ve karar verme için sürücüsüz araç teknolojileri.

- Oyun: Oyun yapay zekası: Oyun yapay zekası, davranış tahmini ve karakter animasyonu.

- Finans: Dolandırıcılık tespiti, kredi puanlaması ve borsa tahmini.

Bunlar sadece birkaç örnek ve teknoloji ilerledikçe derin öğrenme için olası uygulamalar da artıyor.

Derin Öğrenmeye Giriş Eğitimi

Python, derin öğrenme alanında yaygın olarak kullanılan bir programlama dilidir. TensorFlow, PyTorch ve Keras gibi birçok popüler derin öğrenme çerçevesi, derin öğrenme modelleri oluşturmayı, eğitmeyi ve dağıtmayı kolaylaştıran Python API'lerine ve kütüphanelerine sahiptir. Python ayrıca öğrenmesi kolay, geniş ve aktif bir topluluğa sahip çok yönlü bir dildir ve bu da onu derin öğrenme alanındaki geliştiriciler ve araştırmacılar arasında popüler bir seçim haline getirmektedir.

Bu eğitimde şunları öğreneceksiniz

- Derin Öğrenmenin Temelleri,

- Yapay Sinir Ağları hakkında genel bilgiler ve nasıl çalıştıkları, gerçek hayatta nasıl kullanıldıklarına dair pratik uygulamalı çalışmalar,

- Python programlama dili ile derin öğrenme modelleri tasarlama,

- Pytorch Tensörleri ve daha gelişmiş Pytorch fonksiyonları,

- Veri Bilimi Projelerinde Dikkat Edilmesi Gerekenler,

- Temel Model, Gradyan, Sigmoid, Doğrusal Olmayan, Düzenlilik, İkili ve Çok Sınıflı Sınıflandırma, Kayıp Fonksiyonu...

Derin öğrenme ve makine öğreniminin büyüleyici dünyasını keşfetmekle ilgileniyorsanız, sizi bugün eğitimlerimize kaydolmaya davet ediyoruz! Uzman eğitmenlerimiz bilgilerini paylaşma ve bu son teknolojilerde ustalaşma yolculuğunuzda size rehberlik etme konusunda tutkuludur. Sunulan çok çeşitli eğitimlerle, ilgi alanlarınıza ve beceri seviyenize uygun bir şey bulacağınızdan emin olabilirsiniz. Bilginizi genişletmek ve kariyer beklentilerinizi artırmak için bu fırsatı kaçırmayın. Daha fazla bilgi edinmek ve derin öğrenme eğitimlerimize kaydolmak için hemen bizimle iletişime geçin!